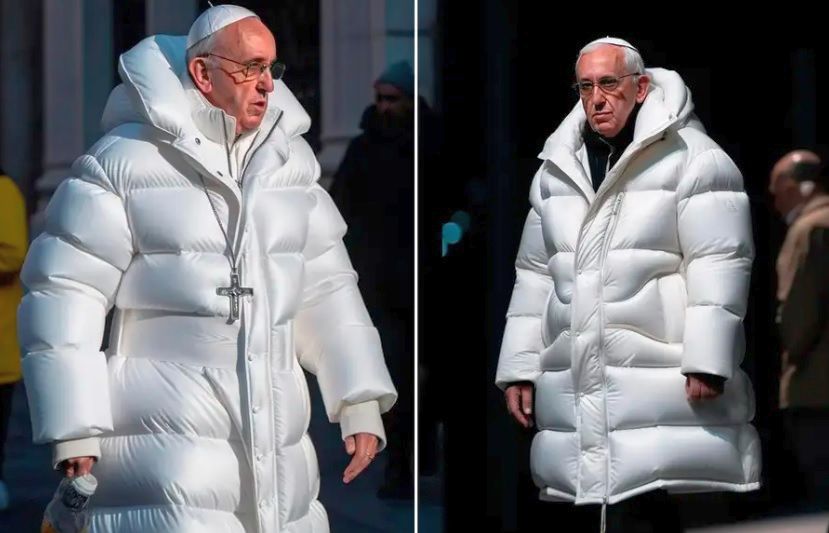

Pedig milyen élethű a pufajkás Ferenc pápáról készült fotó! Aztán kiderült, hogy deep fake, olyan mesterséges intelligencia segítségével készült digitális termék, aminek semmi köze a realitáshoz, noha az interneten terjedő milliárdnyi kép között ugyanolyan valóságosnak tűnt, mint bármelyik másik fotó.

A mesterséges intelligencia (MI, az angol betűszó rövidítésével AI) már aránylag hosszú ideje velünk van, de két tényező irányította rá a világ figyelmét erre a még eszköznek nevezhető, de az embertől egyre gyorsabban függetlenedő elmére. Tavaly novemberben jelent meg a ChatGPT, ami hatalmas népszerűségnek örvend, néhány hónap alatt több millióra növekedett a felhasználóinak a száma. Az MI-rendszerek hozzáférhetőségével – és a ChatGPT pont ezt teszi – tulajdonképpen mindenki programozóvá válhat, mert nem kell megtanulni informatikai kódokat írni, elég egyszerű mondatokban utasításokat adni az eszköznek, és az létrehozza az eredményt az előzetes elképzelések alapján. Felmerül azonban két probléma. Az egyik aggodalomra okot adó tényező az, hogy ezek az MI-rendszerek fekete doboz-szerűen működnek, amelyekbe a felhasználó betáplálja az inputot, de nem tudni és hogy mi zajlik le a rendszer belsejében, hanem csak kijön egy output, és az így megszülető eredmény sokszor meghökkentően meggyőző, máskor pedig zavarba ejtően téves. A tudásnak ez a hiánya, hogy miképpen is generálja az MI az utasításokra adott válaszokat, illetve magának az MI-nek a szédületes és már öngerjesztő fejlődése megijesztette a szakembereket.

Olyannyira, hogy idén márciusban megjelent egy Elon Musk tech guru, és Steve Wozniak Apple társalapító nevével fémjelzett nyílt levél, amelyet időközben már több mint háromezren írtak alá, és amelyben arra figyelmeztettek, hogy az MI-rendszerek nagyon komoly kockázatokat jelenthetnek a társadalomra és az emberiségre nézve. A levél aláírói úgy vélik, hogy a mesterséges intelligenciával foglalkozó laboratóriumok versenyt folytatnak az egyre erősebb digitális elmék kifejlesztése és bevetése érdekében, csakhogy ezeket az eszközöket senki, még alkotóik sem tudják megérteni vagy megbízhatóan irányítani. A megfelelő biztonsági elemek és rendszerek kiépítése nem tud lépést tartani a fejlesztés szédületes ütemével, ezért a nyílt levél aláírói azt javasolták, hogy minden mesterséges intelligenciával foglalkozó laboratórium legalább hat hónapig függessze fel a GPT-4-nél erősebb MI-rendszerek fejlesztését.

Arról nem tudni, hogy a médiavisszhangon kívül bármilyen foganatja lett volna ennek a felhívásnak, mindenesetre május végén egy újabb, mindössze egy mondatos nyílt levél látott napvilágot, mely nem kevesebbet állít, mint azt, hogy az MI technológia egy napon kipusztíthatja az emberiséget, ezért azt a világjárványokkal és az atomháborúkkal egyenrangú társadalmi kockázatnak kell tekinteni. A levelet a mesterséges intelligencia kifejlesztésében vezető szerepet játszó ipari vállalkozók írták alá: ott található közöttük az MI „keresztapjának” nevezett Geoffrey Hinton professzor, Sam Altman, a ChatGPT-t kifejlesztő OpenAI cég vezérigazgatója, valamint Demis Hassabis, a Google DeepMind, és Dario Amodei, az Anthropic vezérigazgatója, továbbá Bill Gates, Yi Zeng professzor, a Kínai Tudományos Akadémia tagja, az Automatizálási Intézet mesterséges intelligencia laboratóriumának az igazgatója, Alvin Wang Graylin, a HTC China elnöke, Albert Efimov, az Orosz Mesterséges Intelligencia Szövetség kutatási vezetője, és sok más szaktekintély, valamint közéleti szereplő a világ minden tájáról. Ezek már olyan erős megnyilvánulások, hogy a jelzett problémával való szembenézést nem lehet tovább halogatni. Az MI fenyegetés egyik szószólója, Yuval Noah Harari filozófus szerint a mesterséges intelligencia feltörte az emberi civilizáció operációs rendszerét, a nyelvet, és ezzel szabad utat nyert az emberek tudatába, illetve teljes kulturális felépítményébe: a gazdaság, a jog, a politika, a vallás a művészet világába, mert mindezeket a nyelv határozza meg.

Az MI nem pusztán önmagától veszélyes, hanem az ember sebezhetősége miatt, ami túlzott hiszékenységéből fakad. Az emberiség történetének egyik alaptapasztalata, hogy vele gyakorlatilag bármit el lehet hitetni, és ez sosem volt nyilvánvalóbb, mint napjainkban. A manipulációk eddig is, MI nélkül is gőzerővel működtek. Vessünk csak egy pillantást a nap mint nap felénk özönlő információáramlásban a különböző narratívákra, amelyeket valakik terjesztenek, mások pedig elhisznek anélkül, hogy a legcsekélyebb mértében ellenőriznék az állításokat. Hányan vannak azok, akik elhiszik azt, hogy a Föld lapos, azt, hogy a bucsai mészárlást az ukránok rendezték meg, azt, hogy nem is volt holokauszt, hogy Soros György személyesen szervezi a migránsáradatot? Az alternatív valóságok terjedését eddig a rendkívül hatékony propagáló közeg, az internet tette lehetővé, amelyet – eddig legalábbis – emberek működtettek, de most korszakhatárhoz érkeztünk, mert a manipulációba új entitásként belép a mesterséges intelligencia, mely képes a fizikai valóságtól teljesen független, mégis tökéletesen hitelt érdemlőnek tűnő képeket, hang- és videótermékeket, narratívákat gyártani, amikkel még a racionális embereket is meg tudja téveszteni.

Ez a veszélyforrás alapvetően befolyásolhatja a társadalmi-politikai rendet. A hihetőnek tűnő, valójában alaptalan diskurzusok gyártásával az emberek közötti értelmes párbeszéd lehetősége szűnik meg, az alternatív valóságokban élők nehezebben értenek szót egymással, mint azok, akik nem beszélik egymás anyanyelvét. Az MI ezt a folyamatot fogja felgyorsítani, alternatív valóságok tömkelege fog megtermelődni, és az emberek úgy fognak tetszés és ízlés, habitus, hangulat alapján szelektálni köztük, ahogy ma a nyakkendőjüket választják ki a szekrényből. Sőt, maguk gyárthatnak immár alternatív valóságokat, miután ChatGPT képében erre rendkívül hatékony eszközt kaptak a kezükbe. Az alternatív valóságok kritikátlan elfogadásának jelenségét könnyíti a nyugati világban divatos nyelvfilozófiai elképzelés, mely a nyelvet nem a fizikai valóságot megnevező, azt leképező eszközként, hanem önálló entitásként képzeli el. A nyelvnek ebben a koncepcióban nincs a fizikai valóság tényeinek megfeleltethető rögzítettsége, hanem attól teljesen függetlenedett struktúra, emiatt az igazságtartalmak megállapítására sem lehet a tényeknek való megfeleltetés kritériumát alkalmazni. A diskurzusok igazságtartalmának kritériuma az, hogy kik és hányan hisznek bennük, illetve a regnáló hatalom mely diskurzust tekinti mérvadónak, amelyet az elnyomás eszközeként használva erőltet rá a társadalomra.

Mert a hatalom felismerte azt, hogy a társadalmak irányíthatatlanná válhatnak, ha számtalan egymással versengő, egymásnak gyakran teljesen ellentmondó egyenrangú diskurzus van forgalomban. Vannak országok, ahol már be is vetették a technológiát, illetve a mesterséges intelligenciát a társadalmi tudat ellenőrzése érdekében. A kínai példa a legismertebb ebben a tekintetben. A hatalmi tudatmanipuláció alaptézise az, hogy a számtalan egymással versengő diskurzus közül az lesz az irányadó, amely a legtöbb csatornán, a lehető legtöbb úton-módon eljut az emberekhez, akiknek tulajdonképpen lehetőségük se legyen elkerülni a manipulatív üzeneteket. Az MI rendkívül hatékony eszköz lehet a hatalom kezében ahhoz, hogy elhitessen bármit a társadalommal, hogy így teremtsen valamiféle egységet a tudatok szintjén.

A társadalmi kockázat másik vetülete az, hogy nem csak a hatalmi érdek kényszeríti ránk saját narratíváját az MI segítségével, de mi magunk hagyatkozunk önként egyre inkább a mesterséges intelligenciára. Lustaságból, időnyerésből vagy más indokok miatt egyre több mindent bízunk rá mindabból, amit nekünk kellene elvégeznünk: diákok írják meg iskolai dolgozatukat a ChatGPT segítségével, a mesterséges intelligencia olvas el helyettünk dokumentumokat, jelentéseket, az kivonatolja számunkra, sőt, válaszol is helyettünk az e-mailekre. Vagyis magunk mondunk le bizonyos kompetenciáinkról az MI javára, sőt, közvetlen emberi kapcsolataink közé iktatunk be egy közvetítőt, amelyről sok mindent nem, de egyvalamit egyelőre biztosan tudunk, azt, hogy nem száz százalékig megbízható. Emiatt a ráhagyatkozás és megbízhatatlanság miatt az emberi kapcsolatok, legyenek azok közösségi vagy magán jellegűek, félrecsúszhatnak vagy teljesen megszűnhetnek.

Nem szeretném úgy befejezni ezt az írást, hogy ne hangsúlyoznám azt, hogy az MI-technológiában hihetetlenül sok pozitív potenciál van. Kézenfekvő, hogy az oktatásban és a gyógyászatban gyorsan nagyon komoly eredményeket lehet elérni a segítségével. Az MI forradalmasíthatja az ipari technológiát, a termelést, felgyorsíthatja a tudományos felfedezéseket, illetve olyan kényes területeken is hozhat pozitív fejleményeket, mint a hadászat vagy a jog. De éppen azért, mert az MI az emberi élet minden szegmensébe beférkőzhet, szükség van egy átfogó, akár globális szabályozásra, ami azt a célt szolgálná, hogy kiépüljenek olyan biztonsági rendszerek, amelyek meggátolják azt, hogy az MI túlnőjön az emberiség ellenőrző képességén. Ilyen biztonsági rendszerek akár az atomegyezményekhez hasonló államközi szerződésekkel is létesülhetnének, ezekben közös garanciákat lehetne vállalni arra, hogy a nemzetek nem használják fel tömegpusztító eszközként a mesterséges intelligenciát.

Az optimisták bíznak ebben a forgatókönyvben, lényegében a fent említett levelek aláírói is abban reménykednek, hogy talán még nem túl késő lépni. De erre csekély az esély, mert az emberiség sorsát nem a tudósok és a lelkiismeretes értelmiség irányítja, hanem a politika. És a globális politikai versengés terepe újabban pont az MI-hajsza. Azok az országok tesznek majd szert előnyre vetélytársaikkal szemben, amelyek hatékonyabb mesterséges intelligencia-technológiát fejlesztenek ki. Az államok sokkal inkább érzékelik a technológiai lemaradásban rejlő veszélyt, mint a mesterséges intelligenciában rejlő kockázatokat, ezért sem fog leállni a fejlesztés, nemhogy hat hónapra, de hat napra sem. És ezért sem lesz érdemi az ellenőrző rendszer, mert ez is csak lassítaná, nehezítené a fejlesztést, holott a gyorsaság a legalapvetőbb tényező az előny kicsikarásában. A versengés önmagában véve is egy olyan öngerjesztő folyamat, ami szinte lehetetlenné teszi az emberiség hosszú távú céljait szem előtt tartó együttműködést, amit csak még jobban hátráltat az ukrajnai háború miatt is mérhetetlenül bizalmatlanná fajuló nemzetközi rendszer. És mindez a mesterséges intelligencia kontrollálatlan növekedésének kedvez. Ha pedig az ember teljesen elveszíti a kontrollt fölötte, akkor az Úr vagy az MI legyen irgalmas hozzánk.